Deepfake - Prof. Dr. Norbert Pohlmann

Deepfake | |

| Inhaltsverzeichnis Was ist eine Deepfake?

Das Ziel von Deepfake ist unter anderem, es so aussehen zu lassen, dass eine Person in einer Audio- und Video-Sequenz etwas sagt und/oder tut, was diese nicht gesagt und/oder getan hat. Dadurch lässt sich zum Beispiel ermöglichen, Individuen oder ganze Personengruppen zu diffamieren oder zu Gewalttaten aufzurufen beziehungsweise Chaos zu stiften. Da die Medien mithilfe von Deep Learning-Verfahren bearbeitet oder entsprechend generiert werden, hat sich dafür der Name Deepfake (Deep Fake) etabliert: Eine Zusammensetzung aus „Deep Learning“ – hochwertige Methoden des maschinellen Lernens – und dem englischen Begriff für Fälschung oder Schwindel „Fake“.

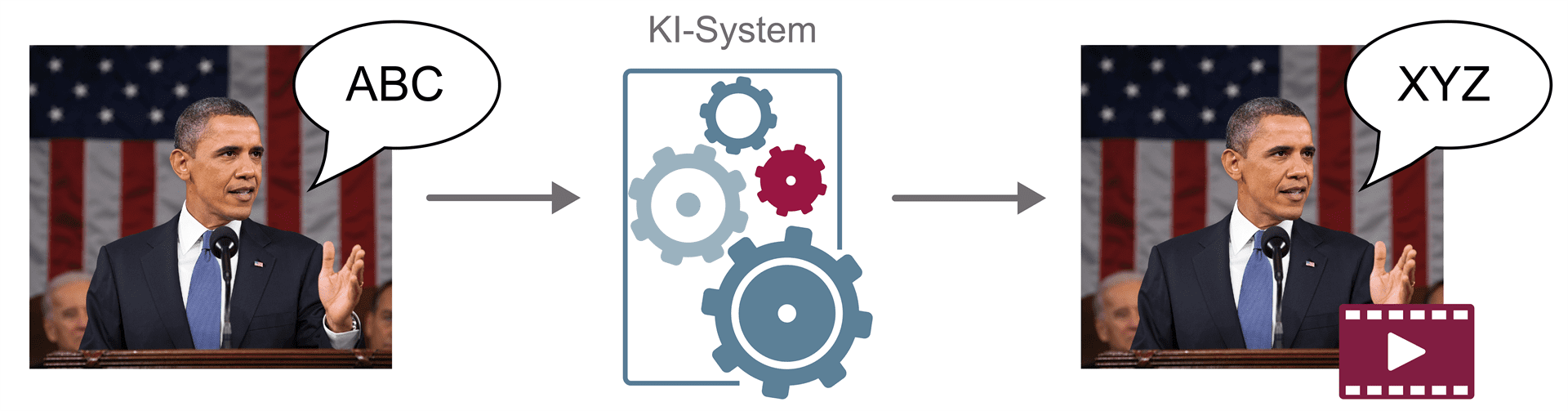

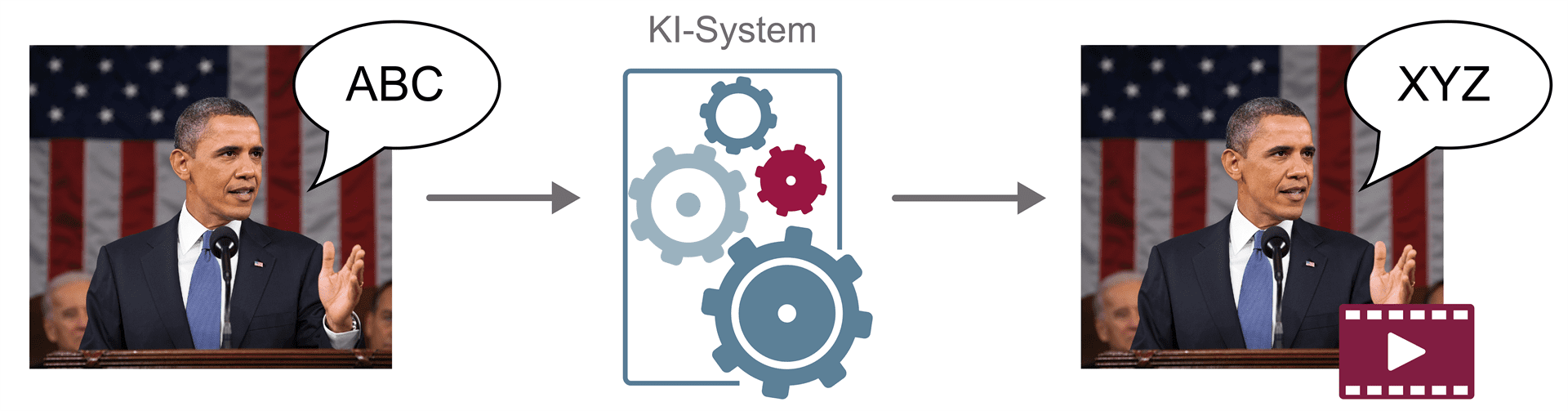

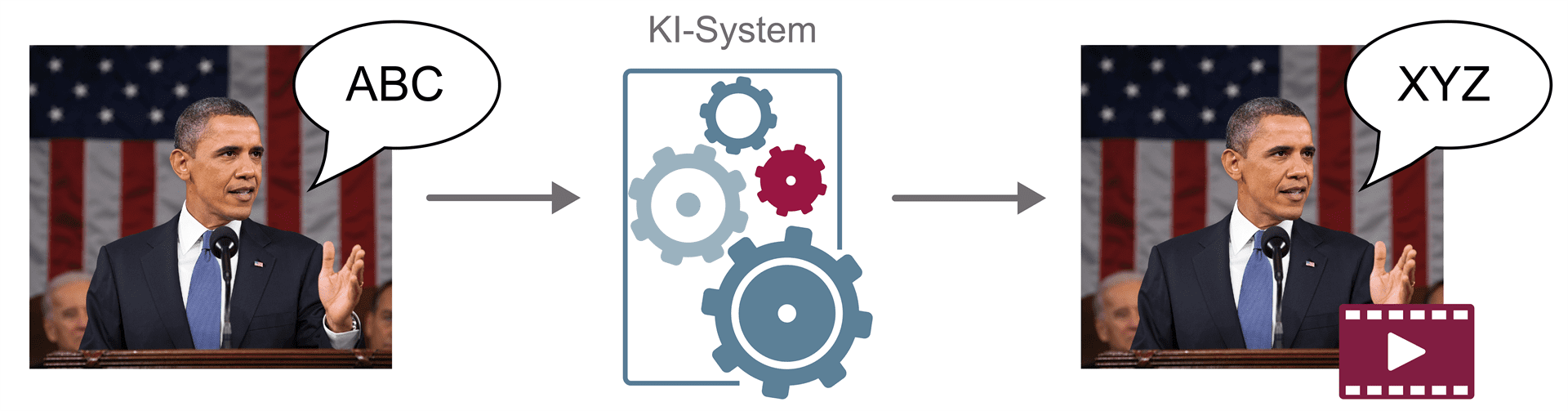

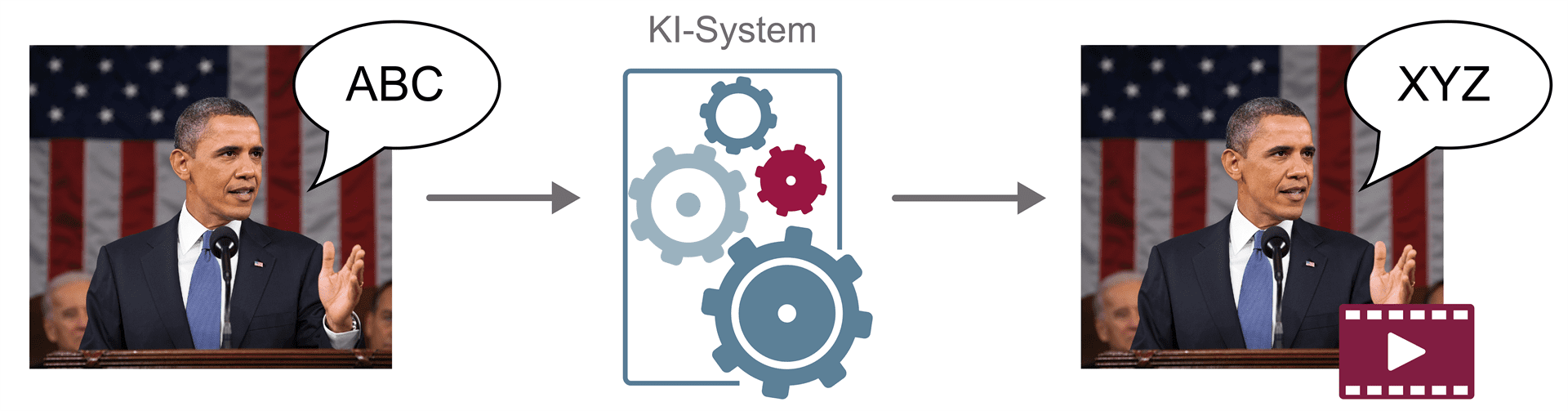

Welche Angriffsmethoden lassen sich mit Deepfake umsetzen?1. Angriff mit gefälschter Personen-Identität durch die Manipulation von Videos Es gibt verschiedene – auf Deep Learning basierte – Verfahren, unter deren Einsatz es möglich ist Videos zu manipulieren. Zum Beispiel indem darin Gesichter ausgetauscht werden (Face Swapping), um ein bestimmtes Ziel zu erreichen. Bei einem entsprechenden Angriff ist somit die Idee, dass der Angreifer entweder der Zielperson in einem bereits existierenden Video „neue Worte in den Mund legt“ oder in einem neuerstellten Video ein Gesicht (zum Beispiel von einer Person in einer Veranstaltung) oder alternativ das eigene, durch das der Zielperson ersetzt. Bei modernen Deep Learning Verfahren bedarf es nur weniger Minuten an Videomaterial der Zielperson, um das KI-System zu trainieren. Dadurch wird der Angreifer unter anderem in die Lage versetzt, (seine gewünschten) Aussagen zu machen und für den Betrachter sieht es so aus, als ob die Zielperson diese tätigen würde. 2. Angriff mit gefälschter Stimme Hierzu werden zum Beispiel Text-to-Speech Verfahren verwendet, die aus einer vorhandenen Textdatei ein Audio-Signal erzeugen. Für einen Angriff werden spezifische Charakteristika einer Zielperson genutzt etwa Dialekte oder eine besondere Betonung, damit das Audio-Signal sich wie die Zielperson anhört. Durch diese Angriffsmethode können sowohl Menschen als auch Spracherkennungsverfahren getäuscht werden. Beim „Voice-Conversion“ wird als Input ein Audio-Signal des Angreifers verwendet – dieses wird dabei so konvertiert, dass es dem Audio-Signal der Zielperson hundertprozentig entspricht. Auch bei diesem Verfahren werden Trainingsdaten – in diesem Fall Audiomaterial – der Zielperson benötig, damit das KI-System die Aufgabe umsetzen kann. 3. Angriff mit gefälschten Texten Bei diesem Angriff werden auf Basis von Texten einer Zielperson mithilfe von KI-Systemen Texte generiert, die so plausibel sind, dass sie von der Zielperson stammen könnten. Diese können dann verwendet werden, um eine Person zu bestimmten Handlungen zu motivieren. Für diesem Angriff können zum Beispiel Social Media-Plattformen verwendet werden – zum einen, um hier Informationen über die Zielperson zu generieren und zum anderen, um einen Angriff auf eine Person durchzuführen. Mögliche Angriffsszenarien von DeepfakeMit den verschiedenen Angriffsmethoden ist es relativ einfach möglich, mediale Identitäten und deren Inhalte zu manipulieren. Im Folgenden werden einige dargestellt: Social Engineering:

Bewertung von DeepfakesDa das Erkennen von Deepfake nicht trivial ist, stellen diese ein sehr großes Risiko dar. Beispiel eines Deepfake-Videos Da im Prinzip nur ausgewiesene Experten ein Deepfake-Video von einem echten Video unterscheiden können, ist es möglich, alle anderen Menschen mit diesem zu täuschen oder zu manipulieren.  Weitere Informationen zum Begriff “Deepfake”:

„Influence of security mechanisms on quality of service with VoIP“ „Menschliche Basis fürs Business – Mechanismen zur Vertrauensbildung“ „Biometrie – Bessere Identifikation, sichere Authentisierung“ „Aktivierung von Smartcards durch Biometrie“ „Übungsaufgaben und Ergebnisse zum Lehrbuch Cyber-Sicherheit“ „Bücher im Bereich Cyber-Sicherheit und IT-Sicherheit zum kostenlosen Download“

„SPHINX – Standard MailTrusT im Praxistest“ „Sicherheit in verteilten Netzwerken“

„Master-Studiengang Internet-Sicherheit (IT-Sicherheit, Cyber-Sicherheit)“ „Marktplatz IT-Sicherheit: IT-Notfall“ „Marktplatz IT-Sicherheit: IT-Sicherheitstools“ „Marktplatz IT-Sicherheit: Selbstlernangebot“ „Marktplatz IT-Sicherheit: Köpfe der IT-Sicherheit“ „Vertrauenswürdigkeits-Plattform“ Zurück zur Übersicht Summary  Article Name Deepfake DescriptionDeepfake sind mithilfe von künstlicher Intelligenz erstellte Audio- oder Video-Sequenzen, mit denen überzeugend Menschen getäuscht und manipuliert werden. Nur Experte können ein Deepfake von einem echten Medium unterscheiden. Author Prof. Norbert Pohlmann Publisher Name Institut für Internet-Sicherheit – if(is) Publisher Logo  |

| |